Hadoop 是當今大數據領域的核心技術之一,以其高效的數據處理與存儲能力廣泛應用于各行各業。作為大數據生態系統的重要支柱,Hadoop 提供了一套可靠的分布式數據存儲和處理框架,能夠處理海量結構化與非結構化數據。本部分將重點介紹 Hadoop 的架構組成,以及大數據存儲與數據處理服務的基本原理和實現方式。

一、Hadoop 架構概述

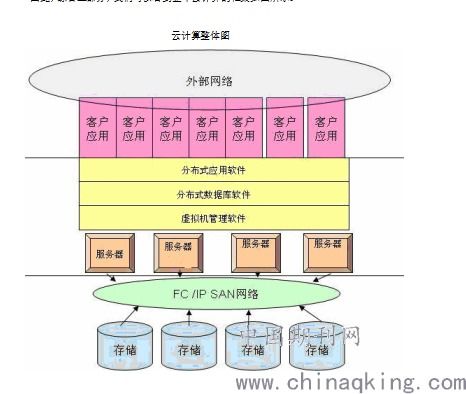

Hadoop 架構主要由兩大核心組件構成:HDFS(Hadoop 分布式文件系統)和 MapReduce。HDFS 負責數據的分布式存儲,它將大規模數據分割成塊(blocks),并分散存儲于集群中的多個節點,確保數據的高可用性和容錯性。而 MapReduce 則是一種分布式計算模型,包含兩個階段:Map 階段負責數據的并行處理與轉換,Reduce 階段則對中間結果進行匯總,生成最終輸出。Hadoop 還包括 YARN(Yet Another Resource Negotiator)作為資源管理器,用于分配計算資源和管理任務調度,進一步優化了集群性能。

二、大數據存儲服務

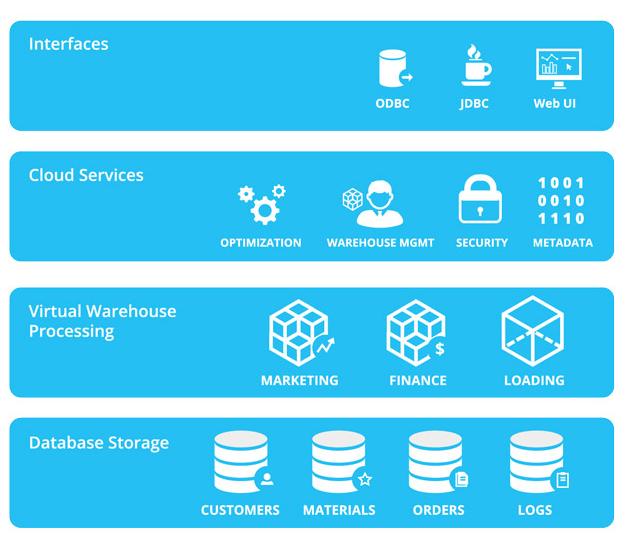

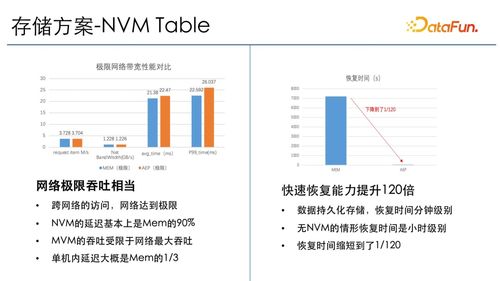

Hadoop 的核心存儲服務依賴于 HDFS。HDFS 設計初衷是支持海量數據存儲,適合一次寫入、多次讀取的場景。它采用主從架構,包括 NameNode(主節點)和多個 DataNode(從節點)。NameNode 負責管理文件系統的元數據(如文件和目錄結構),而 DataNode 則存儲實際數據塊。這種分布式存儲方式不僅提升了數據的可靠性和冗余備份能力,還能通過橫向擴展輕松應對數據增長。除了 HDFS,Hadoop 生態中還有其他存儲選項,例如 HBase(分布式 NoSQL 數據庫),適用于實時讀寫場景,以及云存儲服務整合,為大數據應用提供靈活性和擴展性。

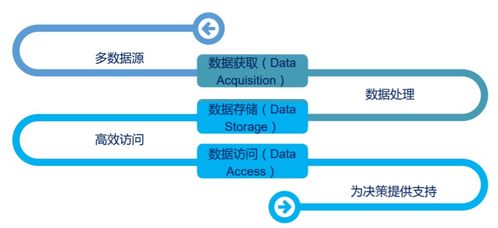

三、數據處理與存儲服務集成

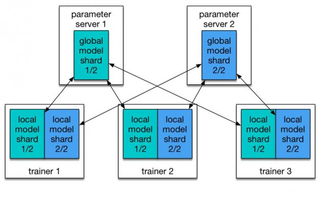

在 Hadoop 框架下,數據處理與存儲服務緊密結合,共同支持大數據應用。MapReduce 作為經典的數據處理引擎,可以高效處理存儲在 HDFS 上的數據,實現批量計算任務。隨著技術演進,Hadoop 生態系統還引入了更高級的處理工具,如 Apache Spark,它通過內存計算加速數據處理過程,并支持流處理和機器學習。數據倉庫解決方案如 Hive 和 Pig 提供了類 SQL 接口,簡化了數據查詢與分析。這些服務通過集成的資源管理(如 YARN)和存儲抽象,使企業能夠構建可擴展的大數據平臺,有效應對數據存儲、處理和分析的多樣化需求。

Hadoop 架構通過其分布式文件系統和并行計算能力,奠定了大數據存儲與處理的基礎。理解 HDFS 的存儲機制和 MapReduce 的數據處理流程,是掌握大數據技術的關鍵。隨著云計算和實時分析需求的增長,Hadoop 生態持續演進,提供更加高效、靈活的數據服務,助力企業從海量數據中提取價值。